IA en UX no es “hacer pantallas”: es reducir fricción operativa

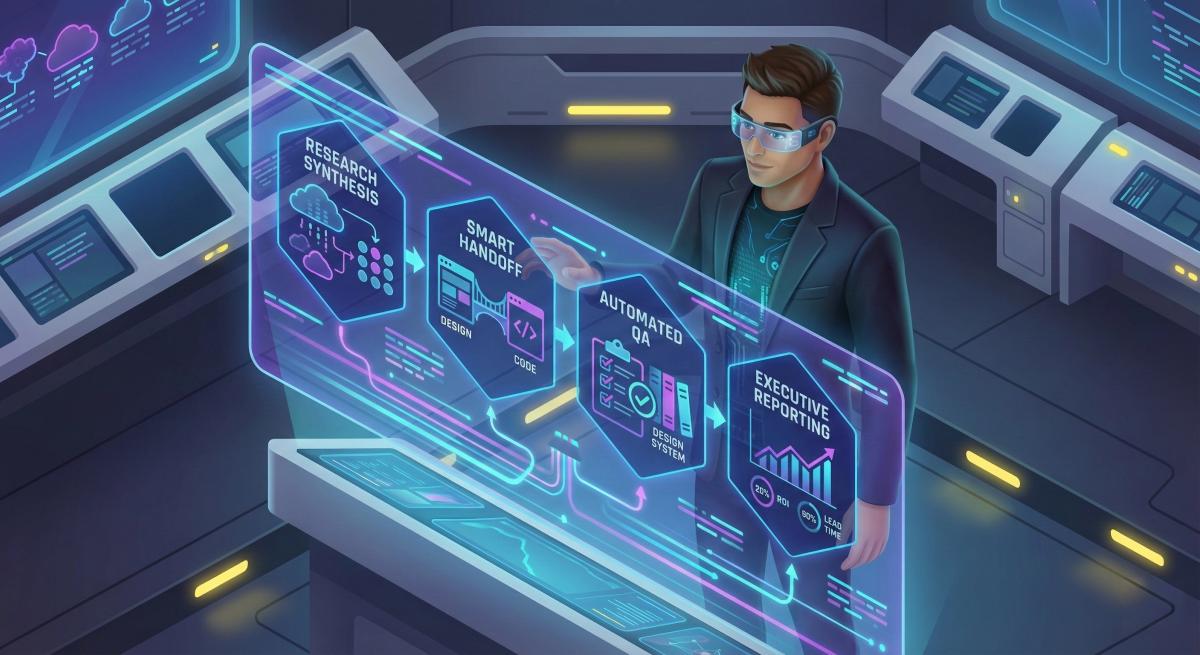

La IA aporta el mayor retorno en UX cuando se aplica a operaciones: síntesis de research, documentación de handoff, QA de consistencia y reporting. El objetivo no es “trabajar menos”, sino elevar la capacidad del equipo: reducir lead time, disminuir retrabajo y mejorar consistencia de delivery sin incrementar headcount.

Tesis: IA no reemplaza criterio de diseño; reemplaza burocracia, variabilidad y tareas repetitivas.

El problema de negocio

En equipos de producto, el cuello de botella no es la creatividad; es la fricción operativa:

- Handoffs incompletos generan interpretaciones, retrabajo y bugs.

- Research se queda en notas; no se convierte en decisiones trazables.

- QA manual depende de heroicidad y memoria.

- Reporting carece de causalidad/hipótesis y no conecta a outcomes.

Resultado: más reuniones, más ciclo, menor calidad percibida y presión por throughput.

Qué automatizar primero (priorización por ROI)

La priorización efectiva combina Impacto (tiempo / defectos / retrabajo) y Esfuerzo (integración, cambio de proceso, riesgo de datos).

Orden recomendado para la mayoría de organizaciones:

- Handoff/Documentación → 2) Research Ops → 3) QA → 4) Reporting

KPIs que debe mover (Operational Efficiency)

Define 1–2 métricas primarias y 2–3 de soporte. Evita “métricas vanidad”.

KPI scorecard sugerido

Eficiencia y velocidad

- Lead time de diseño a build (días)

- Cycle time de iteraciones de handoff (número de rondas)

- Time-to-insight (entre fin de investigación y decisiones)

Calidad y retrabajo

- Defect leakage (issues UX/UI detectados post-release)

- Rework rate (horas o tickets reabiertos por ambigüedad)

- Consistency score (violaciones de tokens/DS por release)

Colaboración

- Clarification load (reuniones/mensajes de aclaración por épica)

- Satisfacción Dev/PM con specs (encuesta breve)

Operating model: cómo se integra IA sin romper delivery

La IA no se “agrega” como herramienta; se diseña como capa de operación con entradas/salidas claras.

Principios de implementación

- Estandariza el input (Figma limpio, naming, componentes, tokens).

- Automatiza salidas auditable (specs, criterios, checklist QA).

- Human-in-the-loop obligatorio donde haya riesgo (research interpretation, decisiones).

- Gobernanza: datos, privacidad, retención, acceso.

Ejemplos operativos (concretos y medibles)

A) Handoff: “AI-Spec” desde Figma → Jira

Output estándar por pantalla/componente:

- Propósito y contexto

- Reglas de interacción

- Estados (loading/empty/error/success)

- Edge cases

- Reglas de accesibilidad (mínimo)

- Eventos analíticos (qué trackear)

- Criterios de aceptación (Given/When/Then)

Impacto típico: menos ambigüedad → menos rework → menor cycle time.

B) Research Ops: síntesis con trazabilidad

Output estándar por estudio:

- Top temas + evidencia (citas)

- Tensiones/contradicciones

- Oportunidades y riesgos

- Hipótesis priorizadas

- Recomendaciones con nivel de confianza

Regla: IA organiza y resume; el equipo valida y decide.

C) QA: consistencia contra Design System

Output estándar por release:

- Violaciones de tokens

- Component usage incorrecto

- Cambios visuales no intencionales (regression)

- Checklist de accesibilidad básica

Impacto típico: menos defect leakage, mayor consistencia percibida.

D) Reporting: UX con accountability

Output estándar mensual:

- Decisiones de UX tomadas

- Métrica primaria y resultado

- Aprendizaje (qué se confirma / descarta)

- Próxima apuesta (backlog de hipótesis)

Plan ejecutivo de piloto (30 días)

Objetivo: probar impacto en un flujo con métricas claras y gobernanza mínima viable.

Semana 1 — Diagnóstico y baseline

- Inventario de tareas repetitivas (por rol)

- Selección del caso: Handoff o Research

- Baseline KPI (últimas 2–4 semanas): lead time, rework, defect leakage, clarification load

- Definir plantillas de salida (AI-Spec / Research Summary)

Entregables: scorecard inicial + plantilla estándar + criterios de éxito.

Semana 2 — Implementación controlada

- Integrar IA en una ceremonia/artefacto (ej. tickets de Jira para 1 épica)

- Entrenar al equipo en “input hygiene” (Figma y notas estructuradas)

- Establecer human review obligatorio (quién aprueba qué)

Entregables: primeros artefactos generados + checklist de revisión.

Semana 3 — Operación y ajuste

- Operar 2–3 sprints/iteraciones del mismo flujo

- Capturar fricción real (qué falla: inputs, prompts, estándares)

- Ajustar plantillas y reglas

Entregables: versión 2.0 del proceso + métricas parciales.

Semana 4 — Evaluación y decisión

- Comparar KPI vs baseline

- Evaluación cualitativa (Dev/PM/QA)

- Recomendación: escalar / ajustar / detener

- Plan 60–90 días si escala

Criterios de éxito (ejemplo):

- -20% en clarification load

- -15% en rework rate

- -10% en lead time (diseño→build) o mejora equivalente en throughput

- Reducción de defect leakage en UI/DS

Gobernanza (mínimo viable, no negociable)

- Clasificación de datos: público / interno / sensible (usuarios, PII, research crudo)

- Dónde corre el modelo: público vs privado (según riesgo)

- Anonimización: reglas obligatorias para research

- Retención: cuánto tiempo y quién accede

- Auditoría: registro de prompts/outputs para trazabilidad (si aplica)

Conclusión

La ventaja competitiva en UX no será producir más pantallas; será entregar con menos fricción, mayor consistencia y decisiones más rápidas, sin crecer linealmente el equipo. La IA, aplicada a UX Ops, es un multiplicador operativo cuando se gobierna bien y se mide con KPIs de eficiencia y calidad.

Si quieres, te estructuro el piloto de 30 días para tu contexto (tooling actual, compliance y métricas) y te dejo un scorecard listo para presentar a Dirección.

Preguntas Frecuentes

¿La IA baja la calidad del research?

No si se usa para síntesis y organización con validación humana.

¿La documentación automática genera errores?

Reduce omisiones, pero exige inputs estructurados.

¿Cuál es el ROI?

Típicamente se materializa en reducción de retrabajo y menor cycle time; lo importante es fijar baseline y medir en piloto.